OpenCV从入门到精通实战(三) |

您所在的位置:网站首页 › Assemble with care更大图像 › OpenCV从入门到精通实战(三) |

OpenCV从入门到精通实战(三)

|

全景图像拼接实现

定义 Stitcher 的类,用于实现两张图片的拼接。使用的技术是基于 SIFT 特征点检测与匹配,以及利用视角变换矩阵来对齐和拼接图像。 import numpy as np import cv2 class Stitcher: #拼接函数 def stitch(self, images, ratio=0.75, reprojThresh=4.0,showMatches=False): #获取输入图片 (imageB, imageA) = images #检测A、B图片的SIFT关键特征点,并计算特征描述子 (kpsA, featuresA) = self.detectAndDescribe(imageA) (kpsB, featuresB) = self.detectAndDescribe(imageB) # 匹配两张图片的所有特征点,返回匹配结果 M = self.matchKeypoints(kpsA, kpsB, featuresA, featuresB, ratio, reprojThresh) # 如果返回结果为空,没有匹配成功的特征点,退出算法 if M is None: return None # 否则,提取匹配结果 # H是3x3视角变换矩阵 (matches, H, status) = M # 将图片A进行视角变换,result是变换后图片 result = cv2.warpPerspective(imageA, H, (imageA.shape[1] + imageB.shape[1], imageA.shape[0])) self.cv_show('result', result) # 将图片B传入result图片最左端 result[0:imageB.shape[0], 0:imageB.shape[1]] = imageB self.cv_show('result', result) # 检测是否需要显示图片匹配 if showMatches: # 生成匹配图片 vis = self.drawMatches(imageA, imageB, kpsA, kpsB, matches, status) # 返回结果 return (result, vis) # 返回匹配结果 return result def cv_show(self,name,img): cv2.imshow(name, img) cv2.waitKey(0) cv2.destroyAllWindows() def detectAndDescribe(self, image): # 将彩色图片转换成灰度图 gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY) # 建立SIFT生成器 descriptor = cv2.SIFT_create() # 检测SIFT特征点,并计算描述子 (kps, features) = descriptor.detectAndCompute(image, None) # 将结果转换成NumPy数组 kps = np.float32([kp.pt for kp in kps]) # 返回特征点集,及对应的描述特征 return (kps, features) def matchKeypoints(self, kpsA, kpsB, featuresA, featuresB, ratio, reprojThresh): # 建立暴力匹配器 matcher = cv2.BFMatcher() # 使用KNN检测来自A、B图的SIFT特征匹配对,K=2 rawMatches = matcher.knnMatch(featuresA, featuresB, 2) matches = [] for m in rawMatches: # 当最近距离跟次近距离的比值小于ratio值时,保留此匹配对 if len(m) == 2 and m[0].distance 4: # 获取匹配对的点坐标 ptsA = np.float32([kpsA[i] for (_, i) in matches]) ptsB = np.float32([kpsB[i] for (i, _) in matches]) # 计算视角变换矩阵 (H, status) = cv2.findHomography(ptsA, ptsB, cv2.RANSAC, reprojThresh) # 返回结果 return (matches, H, status) # 如果匹配对小于4时,返回None return None def drawMatches(self, imageA, imageB, kpsA, kpsB, matches, status): # 初始化可视化图片,将A、B图左右连接到一起 (hA, wA) = imageA.shape[:2] (hB, wB) = imageB.shape[:2] vis = np.zeros((max(hA, hB), wA + wB, 3), dtype="uint8") vis[0:hA, 0:wA] = imageA vis[0:hB, wA:] = imageB # 联合遍历,画出匹配对 for ((trainIdx, queryIdx), s) in zip(matches, status): # 当点对匹配成功时,画到可视化图上 if s == 1: # 画出匹配对 ptA = (int(kpsA[queryIdx][0]), int(kpsA[queryIdx][1])) ptB = (int(kpsB[trainIdx][0]) + wA, int(kpsB[trainIdx][1])) cv2.line(vis, ptA, ptB, (0, 255, 0), 1) # 返回可视化结果 return vis 类和方法解释:stitch 方法: 输入参数:images 是包含两张图片的元组,ratio 用于筛选匹配的阈值,reprojThresh 是计算单应性矩阵的阈值,showMatches 决定是否显示匹配结果图。功能:拼接两张图片,并可选择是否显示匹配过程中的关键点匹配。流程: 使用 detectAndDescribe 方法分别检测两张图片的 SIFT 特征点和计算描述子。使用 matchKeypoints 方法对特征点进行匹配。判断匹配是否成功;若成功,使用单应性矩阵 H 通过透视变换对其中一张图片进行变换,然后与另一张图片合并。cv_show 方法: 显示图像并等待用户关闭窗口。detectAndDescribe 方法: 功能:将输入的图像转换为灰度图,然后使用 SIFT 算法检测关键点并计算描述子。返回:关键点的位置和对应的描述子。matchKeypoints 方法: 功能:对输入的两组特征描述子进行匹配。实现:使用 KNN (K-Nearest Neighbors) 方法,具体为 K=2,这意味着每个点会找到两个最近的邻点以决定是否为好的匹配。匹配准则:最近距离与次近距离的比值小于 ratio 时认为是好的匹配。当筛选后的匹配对数量足够多(大于4)时,使用这些匹配点计算单应性矩阵 H。drawMatches 方法: 功能:可视化显示两图的匹配情况。实现:在一张新图上并排显示两张原图,并将匹配的点对用线连接起来。 重要步骤总结:特征点检测与描述子计算: 使用 SIFT 算法检测图像的关键点,并计算每个点的描述子。这一步是识别图像中的特征并提取有用信息的关键步骤。特征点匹配: 使用 KNN 和比值测试来筛选良好的匹配点。这一步是确保两图中对应的特征点确实相似,为后续的图像对齐打下基础。计算单应性矩阵并进行图像变换: 使用 RANSAC 算法基于匹配点对计算单应性矩阵,这一矩阵能够描述一张图像到另一张图像的透视变换。使用该矩阵通过透视变换将一张图像变形,使其与另一张图像对齐。图像拼接: 将变换后的图像与另一张图像合并,形成一个单一的更大的图像。结果展示: 可选地显示特征点的匹配情况,帮助理解两图是如何通过匹配点关联起来的。骤,可以更好地理解和验证算法的有效性及精确性。 知识点讲解:SIFT(Scale-Invariant Feature Transform): SIFT 是一种用于图像特征检测的算法,非常适合于进行图像匹配及物体识别。关键的优势在于它对图像的缩放、旋转甚至是亮度变化都保持不变性,使其在不同视角和环境下的图像匹配中表现出色。特征匹配与筛选机制: 通过 KNN 算法获取每个特征点的最近邻点。然后利用 Lowe 的比值测试,即最近距离与次近距离的比值小于某个阈值(通常是 0.75),来判断是否为好的匹配。这种方法可以有效减少错误匹配的可能。单应性矩阵(Homography): 单应性矩阵是一个 3x3 的变换矩阵,它描述了两个平面之间的透视变换。在图像拼接中,单应性矩阵用于将一个图像通过透视变换调整,使其与另一个图像对齐。RANSAC(Random Sample Consensus)算法: RANSAC 是一种鲁棒的参数估计方法,用于从一组包含异常值的观测数据中估计数学模型的参数。在特征点匹配过程中,RANSAC 能够帮助排除错误的匹配点,提供更准确的单应性矩阵估计。图像变换和拼接: 利用计算得到的单应性矩阵,通过 cv2.warpPerspective 方法对一张图像进行透视变换。变换后的图像会根据单应性矩阵调整其视角,以便与另一张图像的视角匹配。随后,将这两张图像合并在一起,形成一个连续的大图像。可视化匹配: 如果需要,可以通过 drawMatches 方法生成一个可视化的匹配结果图,该图展示了两张图像中被成功匹配的特征点和它们之间的连线。这对于分析和展示匹配效果非常有用。 调用实践 from Stitcher import Stitcher import cv2 # 读取拼接图片 imageA = cv2.imread("left_01.png") imageB = cv2.imread("right_01.png") # 把图片拼接成全景图 stitcher = Stitcher() (result, vis) = stitcher.stitch([imageA, imageB], showMatches=True) # 显示所有图片 cv2.imshow("Image A", imageA) cv2.imshow("Image B", imageB) cv2.imshow("Keypoint Matches", vis) cv2.imshow("Result", result) cv2.waitKey(0) cv2.destroyAllWindows()拼接前图像

|

【本文地址】

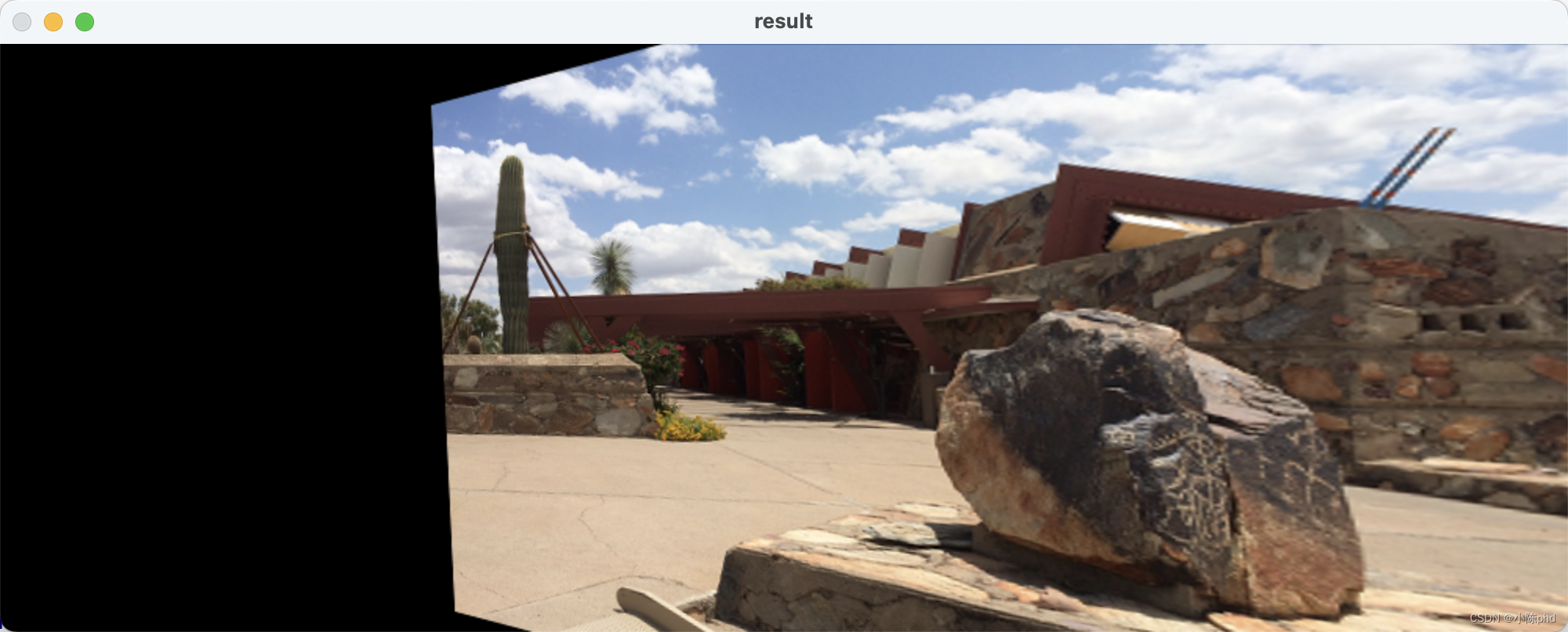

结果:

结果:  资料下载地址 -------------------- 全景图像拼接

资料下载地址 -------------------- 全景图像拼接